История с политикой безопасности чат-бота Anthropic и его продукта Claude выглядит как пример того, как индустрия искусственного интеллекта постепенно уходит от модели «максимальной доступности» к модели «контролируемого доступа». И если раньше нейросети старались как можно быстрее нарастить аудиторию, то теперь акцент всё чаще смещается на управление рисками — юридическими, репутационными и инфраструктурными.

Формально всё выглядит довольно стандартно: в пользовательском соглашении прописано право компании ограничивать или полностью прекращать доступ к сервису в случае нарушений. Но на практике это право реализуется гораздо шире и жёстче, чем многие пользователи ожидают. Речь идёт не только о явных нарушениях вроде спама, злоупотребления API или попыток генерации запрещённого контента. Под удар могут попасть и более «серые» сценарии — например, нестандартная модель использования, подозрительная активность или даже просто несоответствие региона.

Ключевая особенность системы — её многоуровневость. Это не один фильтр, а целый набор механизмов, которые работают одновременно: автоматическая модерация, поведенческая аналитика, проверка IP, сопоставление платёжных данных и, при необходимости, ручная проверка. В результате пользователь может столкнуться с блокировкой не как с итогом одного нарушения, а как с накопительным эффектом нескольких факторов, каждый из которых по отдельности мог бы и не вызвать санкций.

Отдельного внимания заслуживает географический фактор. В отличие от многих цифровых сервисов, которые формально ограничивают доступ, но на практике закрывают глаза на использование VPN, здесь подход заметно жёстче. Если платформа официально не поддерживает определённую страну, то попытка обойти это ограничение уже сама по себе рассматривается как риск. И речь не только о текущем подключении, а о совокупности сигналов: частая смена IP, несоответствие между геолокацией и платёжной информацией, нестабильные сессии. Всё это формирует профиль, который система может интерпретировать как попытку обхода правил.

Именно здесь возникает интересный парадокс современной цифровой безопасности: чем более продвинутой становится инфраструктура, тем меньше остаётся пространства для «гибкости» пользователя. Если раньше можно было спокойно пользоваться сервисом из любой точки мира, то теперь география становится частью идентичности аккаунта.

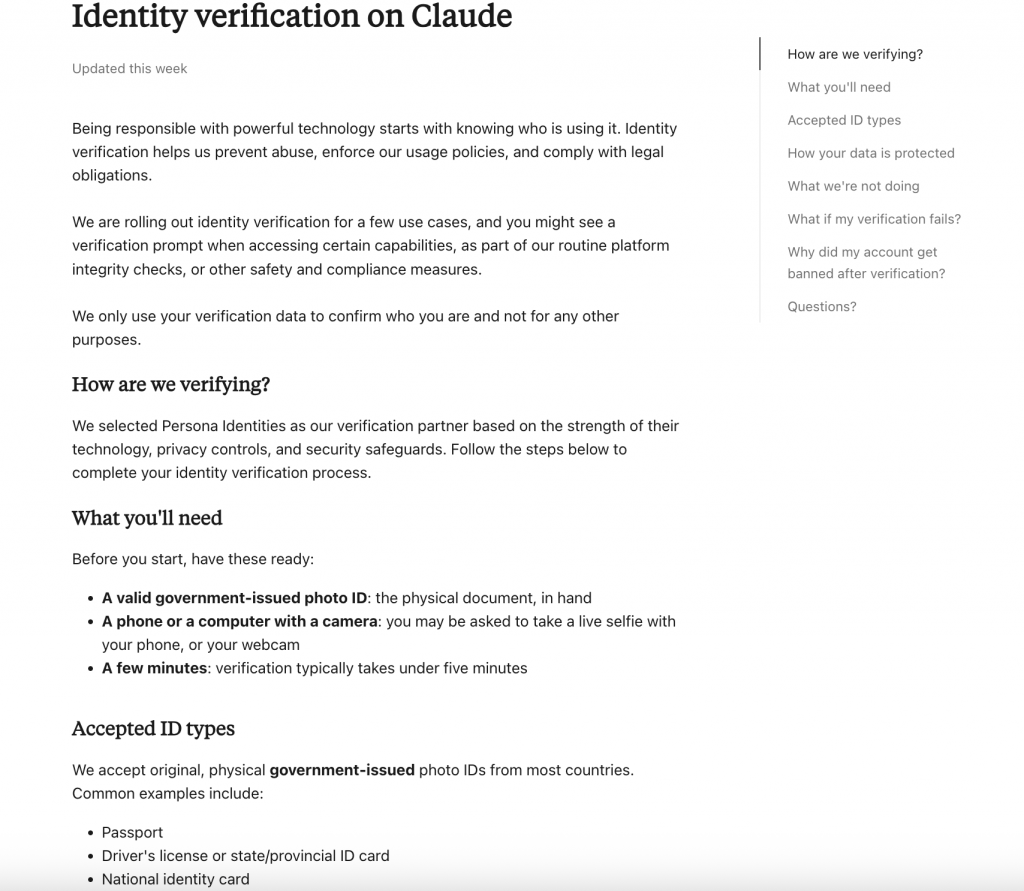

Следующий уровень — это верификация личности. С внедрением процедуры KYC через партнёра Persona платформа фактически переняла практики финансового сектора. И хотя официально говорится о «ограниченных случаях», сама архитектура системы подразумевает, что триггером может стать практически любой фактор — от подозрительного входа до попытки оформить подписку.

При этом важен не сам факт проверки, а способ её реализации. В отличие от классических сценариев, где достаточно загрузить скан документа, здесь используется «живая» верификация. Пользователь должен в реальном времени показать физический документ через камеру, подтвердить своё присутствие и пройти серию проверок на подлинность. Это делает процесс гораздо более надёжным с точки зрения безопасности, но одновременно резко повышает порог входа.

Паспортный режим Claude

Особенно чувствительной точкой становится момент оплаты. Как только пользователь переходит из бесплатного режима в платный, уровень контроля автоматически повышается. Платёжные данные становятся ещё одним источником проверки, и любые несоответствия — будь то страна карты или IP-адрес — могут привести к дополнительной верификации или даже блокировке. Это логично с точки зрения борьбы с мошенничеством, но создаёт дополнительную нагрузку на добросовестных пользователей.

Интересно, что на практике формируется довольно неожиданный эффект: бесплатные аккаунты часто живут «спокойнее», чем платные. Пока пользователь не взаимодействует с финансовой частью сервиса, он остаётся в более мягком режиме контроля. Но как только появляются деньги, включается полноценная система комплаенса, характерная скорее для банков, чем для IT-продукта.

В более широком контексте это отражает общий сдвиг в индустрии. Искусственный интеллект перестаёт быть экспериментальной технологией и превращается в инфраструктуру, которая несёт за собой юридическую ответственность. А значит, компании вынуждены выстраивать системы контроля, сопоставимые с финансовыми и государственными стандартами.

Отсюда и возникает ощущение «жёсткости» или даже односторонности правил. Пользователь действительно оказывается в позиции, где у него мало инструментов влияния: решения принимаются алгоритмами и внутренними процедурами, а прозрачность этих процессов ограничена. Но с точки зрения компании логика понятна — лучше потерять часть аудитории, чем столкнуться с регуляторными рисками или злоупотреблениями.

В итоге мы видим не просто отдельный кейс, а симптом более широкой трансформации. Платформы вроде Claude постепенно переходят от модели «открытого доступа» к модели «доверенного доступа», где право пользоваться сервисом нужно не только получить, но и постоянно подтверждать. И главный вопрос здесь уже не в технологиях, а в балансе: сколько контроля готов принять пользователь в обмен на доступ к инструментам нового поколения.

ОТКАЗ ОТ ОТВЕТСТВЕННОСТИ: Все материалы, представленные на этом сайте (https://wildinwest.com/), включая вложения, ссылки или материалы, на которые ссылается компания, предназначены исключительно для информационных и развлекательных целей и не должны рассматриваться как финансовая консультация. Материалы третьих лиц остаются собственностью их соответствующих владельцев.