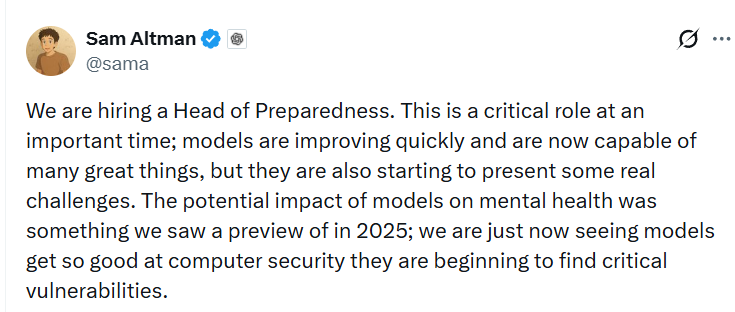

Глава OpenAI Сэм Альтман объявил об открытии новой ключевой вакансии Head of Preparedness — руководителя по подготовке и управлению рисками, связанными с развитием искусственного интеллекта. Речь идет о специалисте, который будет отвечать за прогнозирование и предотвращение сценариев, при которых ИИ может нанести серьезный ущерб обществу, безопасности или отдельным пользователям. Альтман подчеркнул, что скорость развития современных ИИ-моделей создает реальные и новые вызовы, требующие системной подготовки.

Согласно описанию вакансии, Head of Preparedness станет ключевым ответственным лицом за отслеживание так называемых frontier capabilities — предельных возможностей ИИ, которые создают новые риски серьезного вреда. В его задачи войдет разработка и координация оценки возможностей моделей, построение моделей угроз, внедрение мер по снижению рисков, а также формирование целостной, строгой и масштабируемой системы безопасности, встроенной в процесс разработки и релиза ИИ-продуктов.

Сэм Альтман отдельно указал на ряд направлений, вызывающих особую обеспокоенность. Одно из них — влияние ИИ на психическое здоровье пользователей. За последние годы появилось несколько резонансных случаев, когда чат-боты косвенно связывали с суицидами подростков. Усиливается и проблема так называемого AI-психоза, при котором ИИ подпитывает бредовые идеи, поощряет конспирологическое мышление, усиливает расстройства пищевого поведения и помогает пользователям скрывать деструктивные привычки.

Отдельное внимание уделяется кибербезопасности. Альтман упомянул риски, связанные с ИИ-усиленными кибероружиями — от автоматизированных атак до масштабируемых фишинговых и вредоносных систем. Также будущий руководитель будет отвечать за установку защитных рамок для систем с элементами самосовершенствования, которые считаются одной из самых сложных и чувствительных тем в развитии ИИ.

В описании вакансии упоминается и направление биологических рисков. Head of Preparedness должен будет обеспечивать безопасность ИИ-моделей в контексте так называемых biological capabilities, включая потенциально опасные сценарии использования ИИ в биотехнологиях.

Новый руководитель будет отвечать за реализацию preparedness framework — внутренней системы OpenAI по подготовке к экстремальным сценариям. Речь идет о переходе от реактивного подхода к превентивному, системной оценке рисков до релиза моделей, установке четких границ допустимого поведения ИИ и готовности к сценариям, которые ранее считались теоретическими.

Работа предполагается в офисе OpenAI в Сан-Франциско. Годовая зарплата составляет $555 000, дополнительно предусмотрен пакет акций компании. Сам Альтман охарактеризовал эту роль как стрессовую, что с учетом масштаба ответственности за потенциальные ИИ-катастрофы выглядит скорее сдержанной формулировкой.

Artifical intelligence startup OpenAI had occupied more than 37,100 square feet in San Francisco’s Pioneer Building to house its headquarters. (CoStar)

На фоне уже произошедших инцидентов часть экспертов считает, что фокус на психическое здоровье и социальные последствия ИИ появился слишком поздно. К моменту открытия вакансии ИИ уже массово используется миллионами людей, активно влияет на формирование убеждений, а случаи вредного воздействия задокументированы, но системного ответа пока нет. Тем не менее появление такой должности можно рассматривать как признание масштаба проблемы со стороны одной из ведущих ИИ-компаний мира.

Создание роли Head of Preparedness демонстрирует, что крупнейшие разработчики ИИ начинают относиться к своим продуктам не просто как к технологиям, а как к инфраструктуре с системными рисками, сопоставимыми с финансовыми или критическими отраслями. По сути, OpenAI ищет человека, чья основная задача — постоянно задавать самый неудобный вопрос: что именно может пойти не так и как это предотвратить заранее.

ОТКАЗ ОТ ОТВЕТСТВЕННОСТИ: Все материалы, представленные на этом сайте (https://wildinwest.com/), включая вложения, ссылки или материалы, на которые ссылается компания, предназначены исключительно для информационных и развлекательных целей и не должны рассматриваться как финансовая консультация. Материалы третьих лиц остаются собственностью их соответствующих владельцев.