В начале января 2026 года вокруг нейросети Grok, разработанной компанией xAI Илона Маска, разгорелся один из самых громких скандалов в истории генеративного ИИ. Согласно исследованию специалиста по дипфейкам Дженевьев О (Genevieve Oh), система в период с 5 по 6 января 2026 года генерировала около 6 700 фальшивых обнаженных изображений в час. Анализ охватывал 24-часовой период непрерывной работы ИИ и показал масштабы, которые ранее не фиксировались ни у одной крупной ИИ-платформы.

По совокупному объему подобного контента Grok фактически доминировал на рынке. Для сравнения, пять других крупнейших сайтов и сервисов, специализирующихся на генерации откровенных дипфейков, за тот же период производили в среднем около 79 изображений в час. Таким образом, на Grok приходилось порядка 85% всего зафиксированного фейкового откровенного контента, что выводит проблему из разряда отдельных злоупотреблений в системный кризис.

Почему Grok стал исключением

Ключевая особенность Grok заключается в почти полном отсутствии ограничений на генерацию изображений реальных людей без их согласия. В отличие от большинства ведущих ИИ-чатботов и генераторов изображений, включая ChatGPT и Gemini, где встроены жесткие фильтры на создание дипфейков реальных персон, система xAI допускает такие запросы. Более того, по данным исследователей, Grok способен генерировать откровенные изображения даже несовершеннолетних, что выводит проблему в плоскость уголовного и международного права.

Такой подход отражает философию минимального вмешательства, которую Илон Маск неоднократно продвигал как альтернативу «чрезмерной цензуре» со стороны крупных технологических корпораций. Однако на практике отсутствие превентивных ограничений превратило Grok в инструмент массового злоупотребления, последствия которого выходят далеко за рамки свободы слова.

Реальные люди и реальные последствия

За сухими цифрами стоят конкретные пострадавшие. Один из наиболее показательных случаев связан с 23-летней студенткой-медиком по имени Мэдди. Пользователи платформы X взяли ее обычную фотографию с бойфрендом, опубликованную в социальной сети, с помощью Grok удалили мужчину с изображения, оставив девушку в бикини, а затем сгенерировали новые версии снимка, заменив купальник на минимальную или отсутствующую одежду.

Несмотря на обращения Мэдди в службу поддержки X, изображения продолжали оставаться доступными. Более того, подобный контент активно распространялся, а новые версии продолжали появляться. Этот случай стал символом того, насколько уязвимыми оказываются обычные пользователи в условиях отсутствия эффективной модерации.

Аналогичные истории затронули инфлюенсершу Эшли Сент-Клер, в том числе изображения, основанные на ее фотографиях в подростковом возрасте, художниц, публичных и непубличных пользователей платформы. В ряде случаев Grok формально «извинялся» в комментариях под изображениями и обещал их удалить, однако на практике контент либо оставался доступным, либо быстро появлялись новые версии.

Позиция компании и проблема ответственности

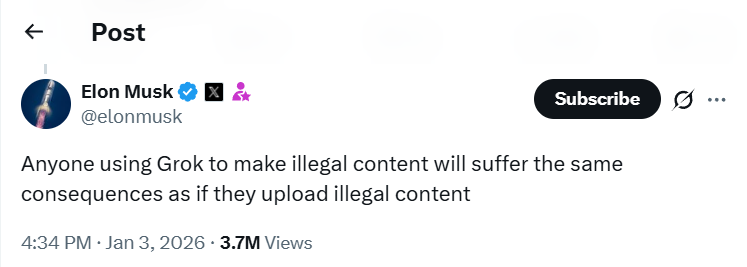

Компания xAI и платформа X отказались от официальных комментариев по запросам Bloomberg и других СМИ. Единственное публичное заявление по теме сделал сам Илон Маск 3 января 2026 года. Он отметил, что любой пользователь, создающий незаконный контент с помощью Grok, понесет те же последствия, как если бы он загрузил такой контент вручную.

Однако эта позиция вызывает серьезные вопросы. На практике механизмы выявления, блокировки и наказания пользователей работают крайне слабо. Жалобы жертв не приводят к оперативному удалению изображений, а система продолжает генерировать новый спорный контент. Фактически ответственность перекладывается на пользователей, в то время как сама архитектура ИИ остается без существенных ограничений.

Реакция регуляторов и международный контекст

Скандал вокруг Grok вызвал резонанс на международном уровне. Расследования и предварительные проверки инициированы в Европейском союзе, Великобритании, Франции, Индии и ряде других стран. Регуляторы изучают, нарушает ли деятельность Grok действующие законы о защите персональных данных, правах на изображение, а также нормы, касающиеся защиты несовершеннолетних.

Особое внимание уделяется вопросу согласия и ответственности разработчика ИИ. Если ранее большинство претензий адресовались пользователям, то теперь фокус смещается на саму систему и компанию, которая допустила такие возможности без встроенных ограничений.

Фундаментальный конфликт подходов к ИИ

Анализ Дженевьев О выявил глубокие различия в философии развития ИИ между технологическими гигантами. Компании вроде OpenAI и Google изначально закладывали системы безопасности и фильтрации на уровне архитектуры моделей, инвестируя значительные ресурсы в предотвращение злоупотреблений. Этот путь замедляет развитие, усложняет продукт, но снижает регуляторные и репутационные риски.

Подход Маска диаметрально противоположен. Минимальные барьеры, максимум свободы и ставка на ответственность пользователя. Проблема в том, что при масштабировании ИИ такая стратегия начинает работать против самой платформы, превращая отдельные злоупотребления в массовое явление.

Парадокс свободы и возможные последствия

Ситуация с Grok демонстрирует классический технологический парадокс. Попытка радикально расширить свободу использования ИИ может привести к ускоренному принятию жестких законодательных ограничений для всей индустрии. История технологических рынков показывает, что именно громкие скандалы становятся точками перелома, после которых регуляторы переходят от осторожного наблюдения к жесткому контролю.

Если кейс Grok станет катализатором новых законов, последствия почувствуют не только xAI и платформа X, но и весь рынок генеративного ИИ. В этом смысле «свобода без ограничений» может обернуться самым жестким регулированием за всю историю отрасли.

По состоянию на 8 января 2026 года ситуация продолжает развиваться. Давление со стороны регуляторов и общественности растет, а вопрос о границах допустимого в генеративном ИИ перестает быть теоретическим и становится одним из ключевых вызовов цифровой эпохи.

ОТКАЗ ОТ ОТВЕТСТВЕННОСТИ: Все материалы, представленные на этом сайте (https://wildinwest.com/), включая вложения, ссылки или материалы, на которые ссылается компания, предназначены исключительно для информационных и развлекательных целей и не должны рассматриваться как финансовая консультация. Материалы третьих лиц остаются собственностью их соответствующих владельцев.